Методы и методики сглаживания мультиколлинеарности. Каскадный анализ.

Если основная задача модели - прогноз будущих значений зависимой переменной, то при достаточно большом коэффициенте детерминации R2 (≥0.9) наличие мультиколлинеарности зачастую не сказывается на прогнозных качествах модели. Хотя это утверждение будет обоснованным лишь в том случае, что и в будущем между коррелированными переменными будут сохраняться те же отношения, что и ранее.

Если же целью исследования является определение степени влияния каждой из объясняющих переменных на зависимую переменную, то наличие мультнколлннеарности, приводящее к увеличению стандартных ошибок, скорее всего, исказит истинные зависимости между переменными. В этой ситуации мультнколлинеарность представляется серьезной проблемой.

Исключение переменной(ых) из модели

Простейшим методом устранения мультиколлинеарности является исключение из модели одной или ряда коррелированных переменных.

В этой ситуации возможны ошибки спецификации. Например, при исследовании спроса на некоторое благо н качество объясняющих переменных можно использовать цену данного блага и цены заменителей данного блага, которые зачастую коррелируют друг с другом. Исключив из модели цены заменителей, мы, скорее всего, допустим ошибку спецификации. Вследствие этого возможно получение смещенных оценок и осуществление необоснованных выводов. Таким образом, в прикладных эконометрических моделях желательно не исключать объясняющие переменные до тех пор, пока коллинеарность не станет серьезной проблемой.

2. Получение дополнительных данных или новой выборки

Т.к. мультиколлинеариость напрямую зависит от выборки, то, возможно, при другой выборке мультиколлинеарности не будет либо она не будет столь серьезной.

Иногда для уменьшения мультиколлинеарности достаточно увеличить объем выборки. Например, при использовании ежегодных данных можно перейти к поквартальным данным. Увеличение количества данных сокращает дисперсии коэффициентов регрессии и тем самым увеличивает их статистическую значимость. Однако получение новой выборки или расширение старой не всегда возможно или связано с серьезными издержками. Кроме того, данный подход может усилить автокорреляцию. Эти проблемы ограничивают возможное использования данного метода.

3. Изменение спецификации модели

В ряде случаев проблема мультиколлинеарности может быть решена изменением спецификации модели: либо изменением формы модели, либо добавлением объясняющих переменных, которые не учтены в первоначальной модели, но существенно влияющие на зависимую переменную. Если данный метод имеет основания, то его использование уменьшает сумму квадратов отклонений, тем самым сокращая стандартную ошибку регрессии. Это приводит к уменьшению стандартных ошибок коэффициентов.

Использование предварительной информации о некоторых параметрах

Иногда при построении модели множественной регрессии можно воспользоваться некоторой предварительной информацией, в частости, извостными значениями некоторых коэффициентов регрессии. Вполне вероятно, что значения коэффициентов, полученные для каких-лнбо предварительных (обычно более простых) моделей, либо для аналогичной модели по ранее полученной выборке, могут быть использованы для разрабатываемой в данный момент модели.

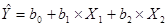

Для иллюстрации приведем следующий пример. Строится регрессия вида (1).

Y = β0+ β1×X1+ β2×X2+ε

Предположим, что переменные X1 и Х2 коррелированны. Для построенной модели парной регрессии Y = γ0+γ1×X1 + ν

был определен статистически значимый коэффициент γ1 (для определенности пусть γ1= 0.8), связывающий Y с Х1. Если есть основания думать, что связь между Y и Х1 останется неизменной, то можно положить, что γ1= β1=0.8. Тогда (1) примет вид:

Y = β0+ 0.8×X1+ β2×X2+ε => Y- 0.8X1 = β0+ β2×X2+ε (2)

Уравнение (2) фактически является уравнением парной регрессии, для которого проблема мультиколлинеарности не существует.

Ограниченность использования данного метода обусловлена тем, что:

1) получение предварительной информации зачастую затруднительно;

2)вероятность того, что выделенный коэффициент регрессии будет одним и тем же для различных моделей, невысока.

Преобразование переменных

В ряде случаев минимизировать либо вообще устранить проблему мультиколлинеарности можно с помощью преобразования переменных.

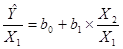

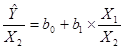

Например, пусть эмпирическое уравнение регрессии имеет вид

(3)

(3)

причем X1 и Х2 - коррелированные переменные. В этой ситуации можно попытаться определять регрессионные зависимости относительных величин

,

,  (4)

(4)

Вполне вероятно, что в моделях, аналогичных (4), проблема мультиколлинеариости будет отсутствовать.

Возможны п другие преобразования, близкие по своей сути к вышеописанным. Например, если в уравнении рассматриваются взаимосвязи номинальных экономических показателей, то для снижения мультиколлинеариости можно попытаться перейти к реальным показателям и т. д.

Дата добавления: 2019-07-15; просмотров: 273; Мы поможем в написании вашей работы! |

Мы поможем в написании ваших работ!