Подготовка входных и выходных параметров

От удачного подбора обучающих примеров во многом зависит успех создания нейронной сети, адекватно моделирующей предметную область. Прежде всего, необходимо понимать, что не все параметры предметной области влияют на выходной вектор Y. Параметры, которые не оказывают влияния на вектор Y, называют незначимыми для этого выходного вектора. Естественно, что незначимые параметры не следует включать в список параметров входного вектора X.

Незначимые параметры могут быть выявлены двумя способами.

· Путем анализа значений весовых коэффициентов входных нейронов. Если окажется, что у какого-либо входного нейрона синаптические веса значительно меньше, чем у других нейронов, то этот входной нейрон скорее всего соответствует незначимому параметру вектора X.

· Путем возмущения значений входных параметров и анализа реакции сети на эти возмущения. Если сеть не реагирует или слабо реагирует на изменения значения какого-либо входного параметра, то этот параметр не является значимым.

После исключения входных нейронов, соответствующих незначимым параметрам, качество нейросети улучшается, т.к. снижается ее размерность.

Предобработка обучающих примеров и интерпретация ответов

Параметры, описывающие предметную область, могут иметь самый разнообразный характер (цвет волос, температура, дата и т.п.) Поскольку нейросеть в состоянии обрабатывать только числа, то вся нечисловая информация должна быть закодирована в числовом виде.

|

|

|

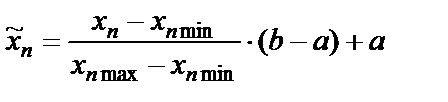

Числовую информацию, приготовленную для нейросетевой обработки, желательно масштабировать, т.е. выровнять диапазоны изменения величин, например, ограничив их интервалами [0,1] или [–1,1]. Сделать это можно с помощью простейшего линейного преобразования:

, (29)

, (29)

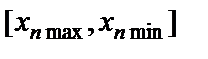

где  и

и  – значения исходного и масштабированного n-го параметра предметной области, подаваемого на n-й входной нейрон сети;

– значения исходного и масштабированного n-го параметра предметной области, подаваемого на n-й входной нейрон сети;

– реальный диапазон изменения n-го параметра;

– реальный диапазон изменения n-го параметра;

[a,b] – приемлемый диапазон изменения входных сигналов.

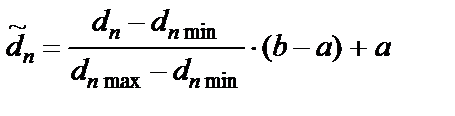

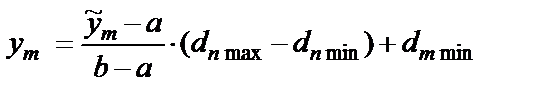

Выходные сигналы персептрона должны быть также закодированы в приемлемой форме и масштабированы в диапазоне [a,b]. Это значит, что при формировании обучающего вектора D следует применить формулу масштабирования, аналогичную (29):

, (30)

, (30)

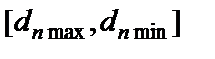

где  и

и  – значения заданного и масштабированного значения m-й компоненты вектора D;

– значения заданного и масштабированного значения m-й компоненты вектора D;  – реальный диапазон изменения m-й компоненты вектора D. Обученный на такой выборке персептрон будет формировать выходной вектор

– реальный диапазон изменения m-й компоненты вектора D. Обученный на такой выборке персептрон будет формировать выходной вектор  , содержащий значения, приведенные к диапазону [a,b]. Поэтому к ним должно быть применено преобразование, обратное масштабированию (30):

, содержащий значения, приведенные к диапазону [a,b]. Поэтому к ним должно быть применено преобразование, обратное масштабированию (30):

|

|

|

. (31)

. (31)

Таким образом, персептрон можно применять для моделирования предметной области, описываемой числовыми параметрами любого диапазона. При формировании обучающей выборки входные и выходные параметры желательно масштабировать – преобразовать к приемлемому диапазону [a,b]. Естественно, что ответы персептрона после этого следует интерпретировать путем применения преобразования, обратного масштабированию.

Контрольные вопросы

1. Что такое искусственный нейрон? Какова его математическая модель?

2. Что такое весовые коэффициенты?

3. В чем суть обучения персептрона?

4. Что такое обучающие примеры?

5. Что такое активационная функция? Какие виды активационных функций вы знаете?

6. Что изменяется в процессе обучения персептрона и по какому закону?

7. Что является условием окончания процесса обучения?

8. Сколько нейронов должно быть во входном слое?

9. Сколько нейронов должно быть в выходном слое?

10. Какие методы применяются при настройке коэффициентов нейросети?

Варианты заданий

Составить программу настройки однослойной нейронной сети для решения задачи из своего варианта. Программа должна не только проводить обучение нейронной сети, но и выполнять проверку работоспособности сети на тестовом множестве примеров.

|

|

|

1. Распознавание по образу четных и нечетных цифр.

2. Распознавание по образу цифры, делящиеся на три.

3. Распознавание по образу цифр от 0 до 9.

4. Распознавать по образу гласные и согласные буквы из заданного диапазона.

5. Распознавать по образу знаки препинания из списка.

6. Распознавание первых десяти букв латинского алфавита.

7. Образ – символ. Распознавать к какой группе относится символ: цифра, буква, спецзнак.

8. Знаки операций. Распознавать, какой знак: «+», «–», «*», «/», другой знак.

9. Смайлики. Распознавать по образу улыбка, грусть, злость, безразличие.

10. Прогноз. Нейронная сеть, прогнозирующая линейный процесс.

11. По образу цифры распознать вид шрифта: курсив, обычный, жирный, подчеркивание и смешанный шрифт.

12. По образу классифицировать геометрическую фигуру: многоугольник, округлая фигура (окружность, эллипс и т.п.).

13. Распознавание по образу символа – цифра или буква

14. Распознавание по образу символа его размера: большой, маленький, средний.

15. Модель заданной логической функции в виде нейросети.

|

|

|

Дата добавления: 2019-11-16; просмотров: 270; Мы поможем в написании вашей работы! |

Мы поможем в написании ваших работ!