Кодирование в каналах без шума

МИНИСТЕРСТВО ОБРАЗОВАНИЯ РОССИЙСКОЙ ФЕДЕРАЦИИ

ВЯТСКИЙ ГОСУДАРСТВЕННЫЙ ТЕХНИЧЕСКИЙ УНИВЕРСИТЕТ

ФАКУЛЬТЕТ АВТОМАТИКИ И ВЫЧИСЛИТЕЛЬНОЙ ТЕХНИКИ

КАФЕДРА РАДИОЭЛЕКТРОННЫХ СРЕДСТВ

КОНТРОЛЬНАЯ РАБОТА

ПО ДИСЦИПЛИНЕ «ТЕОРИЯ ИНФОРМАЦИИ И КОДИРОВАНИЯ»

Вариант 14

РАЗРАБОТАЛ: Халтурин В.Н.____________

РУКОВОДИТЕЛЬ: ст. преподаватель Медведева Е.В.___________

Киров

Теория информации

Задача 1.1.

Источник сообщений выдаёт символы из ансамбля А={ai}. Распределение вероятностей приведено в таблице 1. Найти количество информации, содержащееся в каждом из символов источника при их независимом выборе (источник без памяти). Вычислить энтропию и избыточность заданного источника.

Количество информации определяется выражением:

Энтропия – это среднее количество информации Н (А), которое приходится на один символ:

Энтропия равна нулю, если с вероятностью единица источником выдаётся одно и то же сообщение. Энтропия максимальна, если символы источника появляются независимо с одинаковой вероятностью:

Избыточность источника:

Избыточность источника зависит как от протяжённости статистических связей между последовательно выбираемыми символами, так и от степени неравновероятности отдельных символов.

Задача 1.2.

Память двоичного стационарного источника с символами 0 и1 простирается лишь на два соседних символа и, следовательно, дискретная последовательность символов, выдаваемых источником, описывается простой цепью Маркова с матрицей переходных вероятностей:

|

|

|

, где

, где  - вероятность символа

- вероятность символа  , при условии, что ему предшествует символ

, при условии, что ему предшествует символ  .

.

Определить энтропию и избыточность двоичного источника без памяти, если дискретный стационарный источник задан с помощью матриц переходных вероятностей.

Кодирование в каналах без шума

Задача 2.1.

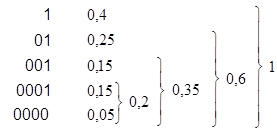

Некоторый дискретный источник выдаёт символы из ансамбля {ai}, с вероятностями, приведёнными в таблице 1. Закодировать символы данного ансамбля кодом Хаффмена, кодом Шеннона-Фано и равномерным кодом. Определить среднюю длину кодовой комбинации и сравнить с энтропией сообщения. Показать, какой код является наиболее эффективным.

Кодирование символов {ai} методом Хаффмена.

Кодирование символов {ai} методом Шеннона-Фано.

Задача 2.2.

Пусть алфавит содержит лишь две буквы  и

и  , появляющееся с вероятностями

, появляющееся с вероятностями  и

и  (таблица 3). Применив метод Шеннона-Фано закодировать сначала каждую букву по отдельности, затем закодировать двух- и трёх- буквенные комбинации. Определить среднюю длину кодовой комбинации для трёх случаев и сравнить её с энтропией сообщения. Определить наилучший результат кодирования.

(таблица 3). Применив метод Шеннона-Фано закодировать сначала каждую букву по отдельности, затем закодировать двух- и трёх- буквенные комбинации. Определить среднюю длину кодовой комбинации для трёх случаев и сравнить её с энтропией сообщения. Определить наилучший результат кодирования.

|

|

|

=0,4

=0,4

=0,6

=0,6

Дата добавления: 2016-01-04; просмотров: 33; Мы поможем в написании вашей работы! |

Мы поможем в написании ваших работ!