Модель множественной линейной регрессии

В экономической практике часто имеет место сложная, многопричинная статистическая связь между признаками.

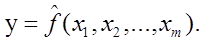

Множественная регрессия представляет собой регрессию результативного признака с двумя и большим числом факторов, т.е. модель вида:

[Елисеева-34]

[Елисеева-34]

Переменная  называется зависимой переменной, в то время как переменные

называется зависимой переменной, в то время как переменные  называются независимыми переменными.[Afifi-164]

называются независимыми переменными.[Afifi-164]

Задача оценки статистической взаимосвязи переменных  и

и  формулируется аналогично случаю парной регрессии. Записывается функция

формулируется аналогично случаю парной регрессии. Записывается функция  , где b- вектор параметров,

, где b- вектор параметров,  -случайная ошибка. Предполагается, что эта функция связывает переменную

-случайная ошибка. Предполагается, что эта функция связывает переменную  с вектором независимых переменных

с вектором независимых переменных  для данной генеральной совокупности. Предполагается, что ошибки

для данной генеральной совокупности. Предполагается, что ошибки  являются случайными величинами с нулевым математическим ожиданием и постоянной дисперсией;

являются случайными величинами с нулевым математическим ожиданием и постоянной дисперсией;  и

и  статистически независимы при

статистически независимы при  . Кроме того, для проверки статистической значимости оценок b обычно предполагается, что ошибки

. Кроме того, для проверки статистической значимости оценок b обычно предполагается, что ошибки  нормально распределены.

нормально распределены.

Для оценивания параметров  применяется, как правило, метод наименьших квадратов. Уравнение регрессии с оцененными параметрами имеет вид

применяется, как правило, метод наименьших квадратов. Уравнение регрессии с оцененными параметрами имеет вид

.[Салманов-44]

.[Салманов-44]

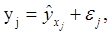

Практически в каждом отдельном случае величина у складывается из двух слагаемых:

где  -фактическое значение результативного признака;

-фактическое значение результативного признака;

-теоретическое значение результативного признака, найденное исходя из соответствующей математической функции связи

-теоретическое значение результативного признака, найденное исходя из соответствующей математической функции связи  и

и  ,т. е. из уравнения регрессии;

,т. е. из уравнения регрессии;

- случайная величина, характеризующая отклонения реального значения результативного признака от теоретического, найденного по уравнению регрессии. . [Елисеева-35]

- случайная величина, характеризующая отклонения реального значения результативного признака от теоретического, найденного по уравнению регрессии. . [Елисеева-35]

Общий смысл оценивания по методу наименьших квадратов заключается в минимизации суммы квадратов отклонений наблюдаемых значений зависимой переменной (  ) от значений, предсказанных моделью(

) от значений, предсказанных моделью(  ).

).

,

,

где S- суммы квадратов отклонений

-остаток в наблюдении j.[net]

-остаток в наблюдении j.[net]

Построение уравнения множественной регрессии начинается с решения вопроса о спецификации модели. Она включает в себя два круга вопросов: отбор факторов и выбор вида уравнения регрессии. [Елисеева-91]

Факторы, включаемые во множественную регрессию, должны отвечать следующим требованиям.

1. Они должны быть количественно измеримы. [Елисеева-92] Для исследования влияния качественных признаков в модель можно вводить бинарные (фиктивные) переменные, которые, как правило, принимают значение 1, если данный качественный признак присутствует в наблюдении, и значение 0 при его отсутствии.[Магнус 100]

2. Факторы не должны быть интеркоррелированы и тем более находиться в точной функциональной связи.

Если между факторами существует высокая корреляция, то нельзя определить их изолированное влияние на результативный показатель и параметры уравнения регрессии оказываются неинтерпретируемыми. [Елисеева-92]

Коэффициенты интеркорреляции (т. е. корреляции между объясняющими переменными) позволяют исключать из модели дублирующие факторы. Считается, что две переменных явно коллинеарны, т. е. находятся между собой в линейной зависимости, если  .

.

По величине парных коэффициентов корреляции обнаруживается лишь явная коллинеарность факторов. Наибольшие трудности в использовании аппарата множественной регрессии возникают при наличии мультиколлинеарности факторов, когда более чем два фактора связаны между собой линейной зависимостью, т.е. имеет место совокупное воздействие факторов друг на друга. Наличие мультиколлинеарности факторов может означать, что некоторые факторы будут всегда действовать в унисон. В результате вариация в исходных данных перестает быть полностью независимой, и нельзя оценить воздействие каждого фактора в отдельности. Чем сильнее мультиколлинеарность факторов, тем менее надежна оценка распределения суммы объясненной вариации по отдельным факторам с помощью метода наименьших квадратов (МНК). [Елисеева-94]

Выделим некоторые наиболее характерные признаки мультиколлинеарности.

1. Небольшое изменение исходных данных (например, добавление новых наблюдений) приводит к существенному изменению оценок коэффициентов модели.

2. Оценки имеют большие стандартные ошибки, малую значимость, в то время как модель в целом является значимой (высокое значение коэффициента детерминации R 2 и соответствующей F-статистики).

3. Оценки коэффициентов имеют неправильные с точки зрения теории знаки или неоправданно большие значения.[Магнус 94]

Подходы к отбору факторов на основе показателей корреляции могут быть разные. Наиболее широкое применение получили следующие методы построения уравнения множественной регрессии:

• метод исключения;

• метод включения;

• шаговый регрессионный анализ.

Каждый из этих методов по-своему решает проблему отбора факторов, давая в целом близкие результаты - отсев факторов из полного его набора (метод исключения), дополнительное введение фактора (метод включения), исключение ранее введенного фактора (шаговый регрессионный анализ).

Как и в парной зависимости, возможны разные виды уравнений множественной регрессии: линейные и нелинейные. [Елисеева-100] Линейные модели регрессии могут быть описаны как линейные в двух отношениях: как линейные по переменным и как линейные по параметрам. Для линейного регрессионного анализа требуется линейность только по параметрам (  ), поскольку нелинейность по переменным (

), поскольку нелинейность по переменным (  ) может быть устранена с помощью изменения определений.[Доугерти 141]

) может быть устранена с помощью изменения определений.[Доугерти 141]

В линейной множественной регрессии параметры при х называются коэффициентами регрессии (  ). Они характеризуют среднее изменение результата (

). Они характеризуют среднее изменение результата (  ) с изменением соответствующего фактора (

) с изменением соответствующего фактора (  ) на единицу при неизмененном значении других факторов, закрепленных на среднем уровне. [Елисеева-100]

) на единицу при неизмененном значении других факторов, закрепленных на среднем уровне. [Елисеева-100]

Оценка значимости коэффициентов чистой регрессии может быть проведена по t-критерию Стьюдента. В этом случае, как и в парной регрессии, для каждого фактора используется формула:

где  - коэффициент чистой регрессии при факторе х i;

- коэффициент чистой регрессии при факторе х i;

- средняя квадратическая ошибка коэффициента регрессии

- средняя квадратическая ошибка коэффициента регрессии  .

.

Для уравнения множественной регрессии

средняя квадратическая ошибка коэффициента регрессии  может быть определена по следующей формуле:

может быть определена по следующей формуле:

где  - среднее квадратическое отклонение для признака у;

- среднее квадратическое отклонение для признака у;

- среднее квадратическое отклонение для признака

- среднее квадратическое отклонение для признака  ;

;

- коэффициент детерминации для уравнения множественной регрессии;

- коэффициент детерминации для уравнения множественной регрессии;

- коэффициент детерминации для зависимости фактора

- коэффициент детерминации для зависимости фактора  со всеми другими факторами уравнения множественной регрессии;

со всеми другими факторами уравнения множественной регрессии;

- число степеней свободы для остаточной суммы квадратов отклонений. [Елисеева-136-137]

- число степеней свободы для остаточной суммы квадратов отклонений. [Елисеева-136-137]

Критический уровень t при любом уровне значимости зависит от числа степеней свободы, которое равно  : число наблюдений минус число оцененных параметров. [Доугерти 154]

: число наблюдений минус число оцененных параметров. [Доугерти 154]

Практическая значимость уравнения множественной регрессии оценивается с помощью показателя множественной корреляции (  ) и его квадрата – коэффициента детерминации (

) и его квадрата – коэффициента детерминации (  ). [Елисеева-112]

). [Елисеева-112]

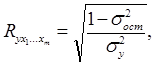

Показатель множественной корреляции может быть найден как индекс множественной корреляции:

где  - общая дисперсия результативного признака;

- общая дисперсия результативного признака;

- остаточная дисперсия для уравнения

- остаточная дисперсия для уравнения

Границы изменения индекса множественной корреляции: от 0 до 1. Чем ближе его значение к 1, тем теснее связь результативного признака со всем набором исследуемых факторов. [Елисеева-113]

Коэффициент детерминации  определяет долю дисперсии

определяет долю дисперсии  , объясненную регрессией. [Доугерти 159]

, объясненную регрессией. [Доугерти 159]

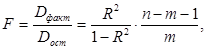

Значимость уравнения множественной регрессии в целом оценивается с помощью F-критерия Фишера:

где  - факторная сумма квадратов на одну степень свободы;

- факторная сумма квадратов на одну степень свободы;

- остаточная сумма квадратов на одну степень свободы;

- остаточная сумма квадратов на одну степень свободы;

- коэффициент (индекс) множественной детерминации;

- коэффициент (индекс) множественной детерминации;

- число параметров при переменных

- число параметров при переменных  (в линейной регрессии совпадает с числом включенных в модель факторов);

(в линейной регрессии совпадает с числом включенных в модель факторов);

- число наблюдений. [Елисеева-129]

- число наблюдений. [Елисеева-129]

Смысл проверяемой гипотезы заключается в том, что все коэффициенты линейной регрессии, за исключением свободного параметра, равны нулю (случай отсутствия линейной функциональной связи).

Величина F имеет распределение Фишера с степенями свободы  . Распределение Фишера - двухпараметрическое распределение неотрицательной случайной величины, являющейся в частном случае при m = 1 квадратом случайной величины, распределенной по Стьюденту. [Салманов 48]. В определенном смысле этот тест дополняет t-тесты, которые используются для проверки значимости вклада отдельных случайных переменных, когда проверяется каждая из гипотез

. Распределение Фишера - двухпараметрическое распределение неотрицательной случайной величины, являющейся в частном случае при m = 1 квадратом случайной величины, распределенной по Стьюденту. [Салманов 48]. В определенном смысле этот тест дополняет t-тесты, которые используются для проверки значимости вклада отдельных случайных переменных, когда проверяется каждая из гипотез  .. [Доугерти 160]

.. [Доугерти 160]

Для проверки нулевой гипотезы при заданном уровне значимости по таблицам находится критическое значение Fкрит, и нулевая гипотеза отвергается, если  .

.

Распределение Фишера может быть использовано не только для проверки гипотезы об одновременном равенстве нулю всех коэффициентов линейной регрессии, но и гипотезы о равенстве нулю части этих коэффициентов. Это особенно важно при развитии линейной регрессионной модели, так как позволяет оценить обоснованность исключения отдельных переменных или их групп из числа объясняющих переменных или, наоборот, включения их в это число. [Салманов 48].

Требования к остаткам

При оценке параметров уравнения регрессии применяется метод наименьших квадратов (МНК). При этом делаются определенные предпосылки относительно случайной составляющей  . В модели

. В модели

случайная составляющая  представляет собой ненаблюдаемую величину. В задачу регрессионного анализа входит не только построение самой модели, но и исследование случайных отклонений

представляет собой ненаблюдаемую величину. В задачу регрессионного анализа входит не только построение самой модели, но и исследование случайных отклонений  , т. е. остаточных величин.

, т. е. остаточных величин.

Проверка статистической достоверности коэффициентов регрессии и корреляции осуществляется с помощью t-критерия Стьюдента, F-критерия Фишера и Z-преобразования (для коэффициентов корреляции). При использовании этих критериев делаются предположения относительно поведения остатков  - остатки представляют собой независимые случайные величины и их среднее значение равно 0; они имеют одинаковую (постоянную) дисперсию и подчиняются нормальному распределению.

- остатки представляют собой независимые случайные величины и их среднее значение равно 0; они имеют одинаковую (постоянную) дисперсию и подчиняются нормальному распределению.

Оценки параметров регрессии должны быть несмещенными, состоятельными и эффективными. Условия, необходимые для получения несмещенных, состоятельных и эффективных оценок, представляют собой предпосылки МНК, соблюдение которых желательно для получения достоверных результатов регрессии.

Исследования остатков  предполагают проверку наличия следующих пяти предпосылок МНК:

предполагают проверку наличия следующих пяти предпосылок МНК:

1) случайный характер остатков;

2) нулевая средняя величина остатков, не зависящая от  ;

;

3) гомоскедастичность - дисперсия каждого отклонения  одинакова для всех значений х;

одинакова для всех значений х;

4) отсутствие автокорреляции остатков. Значения остатков  распределены независимо друг от друга;

распределены независимо друг от друга;

5) остатки подчиняются нормальному распределению.

Если распределение случайных остатков  не соответствует некоторым предпосылкам МНК, то следует корректировать модель.

не соответствует некоторым предпосылкам МНК, то следует корректировать модель.

Прежде всего проверяется случайный xapактер остатков  - первая предпосылка МНК.

- первая предпосылка МНК.

С этой целью стоится график зависимости остатков  от теоретических значений результативного признака (рис. 3.2).

от теоретических значений результативного признака (рис. 3.2).

Рис.3.2. Зависимость случайных остатков  от теоретических значений

от теоретических значений

Если на графике получена горизонтальная полоса, то остатки  представляют собой случайные величины и MНK оправдан, теоретические значения

представляют собой случайные величины и MНK оправдан, теоретические значения  хорошо аппроксимирует фактические значения у.

хорошо аппроксимирует фактические значения у.

Возможны следующие случаи: если  зависит от

зависит от  , то:

, то:

а) остатки  не случайны;

не случайны;

б) остатки  не имеют постоянной дисперсии;

не имеют постоянной дисперсии;

в) остатки  носят систематический характер.

носят систематический характер.

В случаях а), б), в) необходимо либо применять другую функцию, либо вводить дополнительную информацию и заново строить уравнение регрессии до тех пор, пока остатки  не будут случайными величинами.

не будут случайными величинами.

Вторая предпосылка МНК относительно нулевой средней величины остатков означает, что  . Это выполнимо для линейных моделей и моделей, нелинейных относительно включаемых переменных.

. Это выполнимо для линейных моделей и моделей, нелинейных относительно включаемых переменных.

Вместе с тем несмещенность оценок коэффициентов регрессии, полученных МНК, зависит от независимости случайных остатков и величин х, что также исследуется в рамках соблюдения второй предпосылки МНК. С этой целью строится график зависимости случайных остатков  от факторов, включенных в регрессию

от факторов, включенных в регрессию  (рис. 3.4).

(рис. 3.4).

Рис. 3.4. Зависимость случайных остатков от величины фактора

Если остатки на графике расположены в виде горизонтальной полосы (рис. 3.4), то они независимы от значений  . Если же график показывает наличие зависимости

. Если же график показывает наличие зависимости  и

и  ,то модель неадекватна.

,то модель неадекватна.

Предпосылка о нормальном распределении остатков позволяет проводить проверку параметров регрессии и корреляции с помощью критериев t, F.[1] Всегда, прежде чем сделать окончательные выводы, стоит рассмотреть распределения представляющих интерес переменных. Можно построить гистограммы или нормальные вероятностные графики остатков для визуального анализа их распределения.[электрон-уч]

В соответствии с третьей предпосылкой МНК требуется, чтобы дисперсия остатков была гомоскедастичной. Это значит, что для каждого значения фактора  остатки

остатки  имеют одинаковую дисперсию. Если это условие применения МНК не соблюдается, то имеет место гетероскедастичность. Наличие гетероскедастичности можно наглядно видеть из поля корреляции (рис. 3.5).

имеют одинаковую дисперсию. Если это условие применения МНК не соблюдается, то имеет место гетероскедастичность. Наличие гетероскедастичности можно наглядно видеть из поля корреляции (рис. 3.5).

Рис. 3.5. Пример гетероскедастичности: дисперсия остатков растет по мере увеличения х;

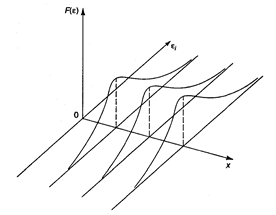

Используя трехмерное изображение, получим следующие графики, иллюстрирующие гомо- и гетероскедастичность (рис. 3.6, 3.7).

Рис. 3.6. Гомоскедастичность остатков

Рис. 3.7. Гетероскедастичность остатков

Рис. 3.6 показывает, что для каждого значения  распределения остатков

распределения остатков  одинаковы в отличие от рис. 3.7, где диапазон варьирования остатков меняется с переходом от одного значения

одинаковы в отличие от рис. 3.7, где диапазон варьирования остатков меняется с переходом от одного значения  другому. Соответственно на рис. 3.7 демонстрируется неодинаковая дисперсия при разных значениях

другому. Соответственно на рис. 3.7 демонстрируется неодинаковая дисперсия при разных значениях  .

.

Наличие гомоскедастичности или гетероскедастичности можно видеть и по рассмотренному выше графику зависимости остатков  от теоретических значений результативного признака

от теоретических значений результативного признака  . Так, для рис 3.5зависимость остатков от

. Так, для рис 3.5зависимость остатков от  представлена на рис. 3.8.

представлена на рис. 3.8.

Рис. 3.8. Гетероскедастичность: большая дисперсия  для больших значений

для больших значений

При построении рефессионных моделей чрезвычайно важно соблюдение четвертой предпосылки МНК - отсутствие автокорреляции остатков, т. е. значения остатков  , распределены независимо друг от друга. Автокорреляция остатков означает наличие корреляции между остатками текущих и предыдущих (последующих) наблюдений. [1]

, распределены независимо друг от друга. Автокорреляция остатков означает наличие корреляции между остатками текущих и предыдущих (последующих) наблюдений. [1]

Одним из основных предполагаемых свойств отклонений  от регрессионной модели является их статистическая независимость между собой. Поскольку значени

от регрессионной модели является их статистическая независимость между собой. Поскольку значени  остаются неизвестными, то проверяется статистическая независимость их аналогов — отклонения

остаются неизвестными, то проверяется статистическая независимость их аналогов — отклонения  (наблюдаемые значения ошибок).При этом устанавливается некоррелированность сдвинутыми на период величинами

(наблюдаемые значения ошибок).При этом устанавливается некоррелированность сдвинутыми на период величинами  . Для этих величин можно рассчитать коэффициент автокорреляции первого порядка (выборочный коэффициент корреляции между

. Для этих величин можно рассчитать коэффициент автокорреляции первого порядка (выборочный коэффициент корреляции между  и

и  ):

):

На практике в качестве теста используют тесно связанную с коэффициентом автокорреляции  статистику Дарбина — Уотсона. Тест Дарбина — Уотсона ( DW ) на наличие или отсутствие автокорреляции ошибок рассчитывается по формуле:

статистику Дарбина — Уотсона. Тест Дарбина — Уотсона ( DW ) на наличие или отсутствие автокорреляции ошибок рассчитывается по формуле:

Нулевая гипотеза состоит в отсутствии автокорреляции. Статистику Дарбина-Уотсона можно выразить через коэффициент автокорреляции:

[2]

[2]

Содержательный смысл статистики Дарбина-Уотсона заключается в следующем: если между  и

и  имеется достаточно высокая положительная корреляция, то

имеется достаточно высокая положительная корреляция, то  и

и  близки друг другу и величина статистики DW мала. Это согласуется с последним выражением: если коэффициент

близки друг другу и величина статистики DW мала. Это согласуется с последним выражением: если коэффициент  близок к единице, то величина D W близка к нулю. Отсутствие корреляции означает, что DW близка к 2. [3]

близок к единице, то величина D W близка к нулю. Отсутствие корреляции означает, что DW близка к 2. [3]

Если бы распределение статистики DW было известно, то для проверки гипотезы  против альтернативы

против альтернативы  можно было бы для заданного уровня значимости (например, для 5%-уровня) найти такое критическое значение

можно было бы для заданного уровня значимости (например, для 5%-уровня) найти такое критическое значение  ,что если

,что если  ,то гипотеза Но не отвергается, в противном случае она отвергается в пользу Н1. Проблема, однако, состоит в том, что распределение DW зависит не только от числа наблюдений п и количества регрессоров к, но и от всей матрицы X , и, значит, практическое применение этой процедуры невозможно. Тем не менее, Дарбин и Уотсон доказали, что существуют две границы, обычно обозначаемые

,то гипотеза Но не отвергается, в противном случае она отвергается в пользу Н1. Проблема, однако, состоит в том, что распределение DW зависит не только от числа наблюдений п и количества регрессоров к, но и от всей матрицы X , и, значит, практическое применение этой процедуры невозможно. Тем не менее, Дарбин и Уотсон доказали, что существуют две границы, обычно обозначаемые  и

и  ,

,  (и = upper - верхняя, l =low - нижняя), которые зависят лишь от n, к и уровня значимости (а следовательно, могут быть затабулированы) и обладают следующим свойством: если

(и = upper - верхняя, l =low - нижняя), которые зависят лишь от n, к и уровня значимости (а следовательно, могут быть затабулированы) и обладают следующим свойством: если  , то

, то  и, значит, гипотеза H 0 не отвергается, а если

и, значит, гипотеза H 0 не отвергается, а если  то

то  , и гипотеза Но отвергается в пользу H 1. В случае

, и гипотеза Но отвергается в пользу H 1. В случае  ситуация неопределенна, т. е. нельзя высказаться в пользу той или иной гипотезы. Если альтернативной является гипотеза об отрицательной корреляции

ситуация неопределенна, т. е. нельзя высказаться в пользу той или иной гипотезы. Если альтернативной является гипотеза об отрицательной корреляции  , то соответствующими верхними и нижними границами будут 4- dl и 4- du . Целесообразно представить эти результаты в виде следующей таблицы.

, то соответствующими верхними и нижними границами будут 4- dl и 4- du . Целесообразно представить эти результаты в виде следующей таблицы.

Таблица 6.3.

Значение статистики DW

| Значение статистики DW | Вывод |

| 4 -dl< DW < 4 | Гипотеза Но отвергается, есть отрицательная корреляция |

| 4 - du < DW < 4 - dl | Неопределенность |

| du < DW < 4 - du | Гипотеза Но не отвергается |

| dl < DW < du | Неопределенность |

| 0 < DW < dl | Гипотеза Но отвергается, есть положительная корреляция |

Наличие зоны неопределенности, представляет определенные трудности при использовании теста Дарбина-Уотсона. [3]

Отсутствие автокорреляции остаточных величин обеспечивает состоятельность и эффективность оценок коэффициентов регрессии.

При несоблюдении основных предпосылок МНК приходится корректировать модель, изменяя ее спецификацию, добавлять (исключать) некоторые факторы, преобразовывать исходные данные для того, чтобы получить оценки коэффициентов регрессии, которые обладают свойством несмещенности, имеют меньшее значение дисперсии остатков и обеспечивают в связи с этим более эффективную статистическую проверку значимости параметров регрессии. [1]

Дата добавления: 2019-07-15; просмотров: 643; Мы поможем в написании вашей работы! |

Мы поможем в написании ваших работ!