Линейный нейрон и линейные сети

Простой нейрон

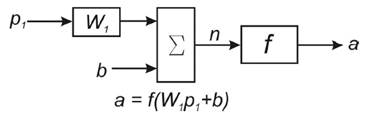

Элементарной ячейкой нейронной сети является нейрон. Структура нейрона с единственным скалярным входом показана на рис. 1.

Рис. 1. Структура нейрона с единственным скалярным входом

Скалярный входной сигнал p умножается на скалярный весовой коэффициент W, и результирующий взвешенный вход W·p является аргументом функции активации нейрона f, которая порождает скалярный выход а.

Нейрон, показанный на рис. 1, дополнен скалярным смещением b. Смещение суммируется со взвешенным входом W·p и приводит к сдвигу аргумента функции f на величину b. Действие смещения можно свести к схеме взвешивания, если представить, что нейрон имеет второй входной сигнал со значением, равным 1 (b·1). Вход n функции активации нейрона по-прежнему остаётся скалярным и равным сумме взвешенного входа и смещения b. Эта сумма

(W·p + b·1) (1)

является аргументом функции активации f, а выходом функции активации является сигнал а.

Константы W и b являются скалярными параметрами нейрона. Основной принцип работы нейронной сети состоит в настройке параметров нейрона таким образом, чтобы поведение сети соответствовало некоторому желаемому поведению. Регулируя веса и параметры смещения, можно обучить сеть выполнять конкретную работу; возможно также, что сеть сама будет корректировать свои параметры, чтобы достичь требуемого результата.

|

|

|

Уравнение нейрона со смещением имеет вид:

a = f (W·p + b·1) (2)

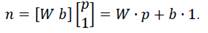

Как уже отмечалось, смещение b – настраиваемый скалярный параметр нейрона, который не является входом. В этом случае b – вес, а константа 1, которая управляет смещением, рассматривается как вход и может быть учтена в виде линейной комбинации векторов входа:

(3)

(3)

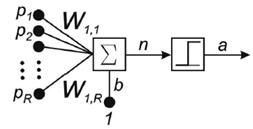

Нейрон с векторным входом

Нейрон с одним вектором входа p с R элементами p1, p2,…, pR показан на рис. 2.

Рис. 2. Нейрон с одним вектором входа

Здесь каждый элемент входа умножается на веса W11, W12,…, W1R соответственно, и взвешенные значения передаются на сумматор. Их сумма равна скалярному произведению вектора-строки W на вектор-столбец входа p.

Нейрон имеет смещение b, которое суммируется со взвешенной суммой входов. Результирующая сумма:

n = W11·p1 + W12·p2 +… + W 1 R · pR + b ·1 или (4)

n = W11p1 + W12 p2 +… + W1R pR + b (5)

|

|

|

и служит аргументом функции активации f.

В векторном виде это выражение записывается так:

n = W·p + b (6)

Входом n функции активации нейрона служит сумма смещения b и произведение W·p. Эта сумма преобразуется функцией активации f, на выходе которой получаем выход нейрона а, который в данном случае является скалярной величиной.

Функции активации

В современных нейронных сетях наиболее часто применяются следующие виды активационных функций (передаточных функций).

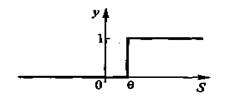

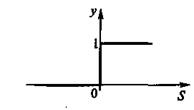

Пороговые активационные функции. Введем пороговую активационную функцию нейрона, представленная на рис.3 с помощью формул:

| (7) |

Выходной сигнал нейрона у может принимать одно из двух значений — нуль или единицу, которые формируются следующим образом:

| у=1, если S³θ; | (8) | |

| у= 0, если S<θ, | (9) |

где θ- порог чувствительности нейрона.

Рис.3. Пороговая активационная функция нейрона

Если в уравнении (7) под S понимать разность между взвешенной суммой входных сигналов и пороговым значением нейрона, т.е.

,

,

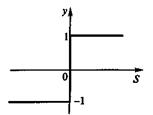

то активационная функция у = f(S) будет иметь вид, показанный на рис.4,а. Однако чаще в нейросетях применяется пороговая функция, симметричная относительно начала координат (рис.4,б).

|

|

|

а) б)

Рис.4. Пороговые активационные функции с несимметричной (а) и симметричной (б)

областями изменения

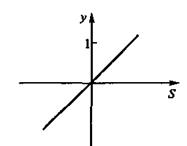

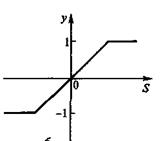

Линейные активационные функции. На рис.5,а показан график линейной активационной функции у = S с неограниченной областью изменения. Такие функции могут быть и с ограниченной областью изменения: у=-1 при S<-1; у=S при -1£S£1; у=1 при S>1 (рис.3.37,б).

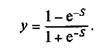

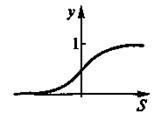

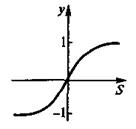

Сигмоидные (логистические) активационные функции. На рис.6,а изображен график сигмоидной функции, заданной уравнением

а на рис.6,б — уравнением

а) б)

Рис.5. Линейные активационные функции: с неограниченной (а) и ограниченной (б)

областями изменения

Аналогичный последнему графику характер имеют функции арктангенса

и гиперболического тангенса у=thS, a также функция

,

,

которые тоже называют сигмоидами.

а) б)

|

|

|

Рис.6. Сигмоидные активационные функции с несимметричной (а) и симметричной (б)

областями изменения

Персептрон

Нейрон, используемый в модели персептрона (нейрон, предложенный Мак-Каллока – Питтса в 1943 г.), имеет ступенчатую функцию активации с жёсткими ограничениями (рис.7, использовано упрощённое изображение нейрона).

Рис.7. Нейрон, используемый в модели персептрона

Каждое значение элемента вектора входа персептрона умножено на соответствующий вес W1j, и сумма полученных взвешенных элементов является входом функции активации. Если вход функции активации n ≥ 0, то нейрон персептрона возвращает 1, если n < 0, то 0.

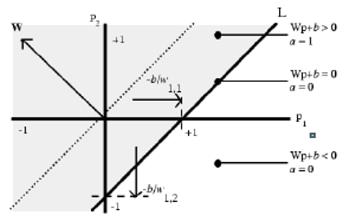

Функция активации с жёсткими ограничениями придаёт персептрону способность классифицировать векторы входа, разделяя пространство входов на две области, как это показано на рис. 8, для персептрона с двумя входами и смещением. Пространство входов делится на две области разделяющей линией L, которая для двумерного случая задаётся уравнением: W m ·p + b = 0 (10)

Эта линия перпендикулярна к вектору весов W и смещена на величину b. Векторы входа выше линии L соответствуют положительному потенциалу нейрона, и, следовательно, выход персептрона для этих векторов будет равен 1; векторы входа ниже линии L соответствуют выходу персептрона, равному 0. При изменении значений смещения и весов граница линии L изменяет свое положение.

Персептрон без смещения всегда формирует разделяющую линию, проходящую через начало координат; добавление смещения формирует линию, которая не проходит через начало координат. В случае, когда размерность вектора входа превышает 2, т.е. входной вектор p имеет более 2 элементов, разделяющей границей будет служить гиперплоскость.

Рис. 8. Функция активации персептрона с двумя входами и смещением

Структура линейной сети

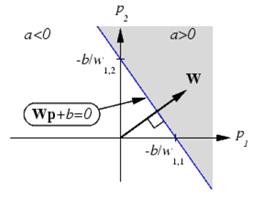

Линейные сети по своей структуре аналогичны персептрону и отличаются лишь функцией активации. Выход линейной сети может принимать любое значение, в то время как выход персептрона ограничен значениями 0 или 1. На рис.9,а показан линейный нейрон с двумя входами. Он имеет структуру, сходную со структурой персептрона. Единственное отличие состоит в том, что используется линейная функция активации.

Весовая матрица W в этом случае имеет только одну строку, и выход сети определяется выражением: a = f ( n ) = f ( Wp + b ) = Wp + b = w 11 p 1 + w 12 p 2 + b

Подобно персептрону, линейная сеть задает в пространстве входов разделяющую линию, на которой функция активации n равна 0 (рис. 9,б). Векторы входа, расположенные выше этой линии, соответствуют положительным значениям выхода, а расположенные ниже – отрицательным. Это означает, что линейная сеть может быть применена для решения задач классификации. Однако такая классификация может быть выполнена только для класса линейно отделимых объектов. Таким образом, линейные сети имеют то же самое ограничение, что и персептрон.

а) б)

Рис. 9 Линейный нейрон с двумя входами (а), линейная сеть в пространстве входов (б)

Нейронная сеть формируется путем соединения многих нейронов. Типичная нейронная сеть состоит из 3 слоев: входной слой, скрытый слой и выходной слой. Входной слой может быть набором объектов, извлеченных из объектов, подлежащих классификации. Затем скрытый слой воздействует на такой набор, а затем передает результат на выходной слой.

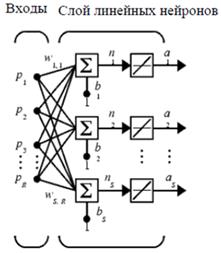

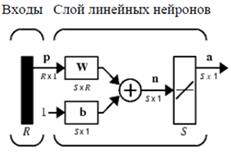

Архитектура сети. Линейная сеть, показанная на рис.10,а, включает S нейронов, размещенных в одном слое и связанных с R входами через матрицу весов W. На рис.10,б показана укрупненная структурная схема этой сети, вектор выхода а которой имеет размер S×1.

а) б)

Рис. 10. Линейная сеть: а) с S нейронами, размещенными в одном слое; б) укрупненная структурная схема этой сети

Дата добавления: 2019-09-13; просмотров: 341; Мы поможем в написании вашей работы! |

Мы поможем в написании ваших работ!